Vår förstahandsupplevelse med AI-bildigenkänningsteknologi, Google Lens, har visat att maskininlärning säkert har kommit väldigt långt. Men den här tekniken är för närvarande långt ifrån perfekt och inte så smart som vi hoppades att den skulle vara, främst för att takten i vilken vi tränar datorer för att identifiera modeller är långsam. Dessutom kräver vissa AI avancerade beräkningar för neurala nätverk, och det är verkligen inte den enklaste uppgiften att lära ut en maskin.

Med tanke på detta tog en grupp Google-forskare sig att testa AI-bildigenkänningssystem och se om de kan luras eller inte.

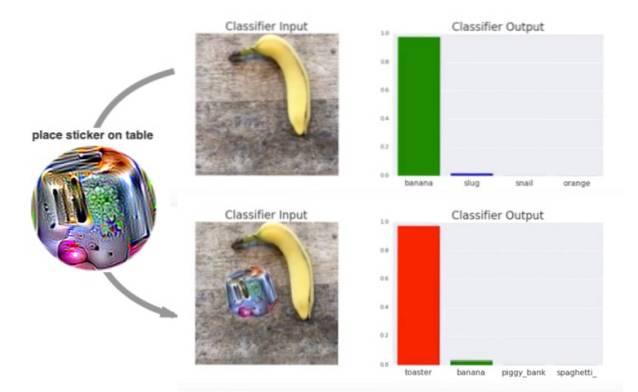

Det verkar som om de har blivit segrande sedan AI-systemet kunde inte känna igen objektet (här, en banan) i provbilderna, allt tack vare en specialtryckt psykedelisk klistermärke.

Skapandet av dessa psykedeliska klistermärken som kan lura bildigenkänningssystem enligt beskrivningen i ett forskningspapper med titeln Adversarial Patch, som just presenterades vid den 31: e konferensen om neurologiska informationsbehandlingssystem i december 2017. Tidningen förklarar att forskare tränade ett motståndarsystem (motståndare) för att skapa små lappliknande psykedeliska cirklar med slumpmässiga former, färger och storlekar för att lura bildigenkänningen systemet.

Medan den vanligaste metoden för att lura AI-bildigenkänningssystem är att ändra en bild genom att lägga till grafik till den, bestämde forskarna på Google att lura systemet med psykedeliska mönster.

Som framgår av videodemo nedan kan systemet känna igen bananen och till en viss grad brödrosten när du placerar en normal bild bredvid bananen. Men resultaten är mindre tydliga när en psykedelisk virvel placeras bredvid bananen:

Teamet fann också att en lappad design visas separat från motivet och påverkas inte av faktorer såsom ljusförhållanden, kameravinklar, objekt i klassificeringsvyn och själva klassificatorn.

Forskarna fortsätter med att förklara hur de psykedeliska designerna fungerar:

Denna attack genererar en bildoberoende patch som är extremt framträdande för ett neuralt nätverk. Denna patch kan sedan placeras var som helst inom klassificeringsfältet och får klassificeringen att mata ut en riktad klass.

Medan det vid första anblicken ser ut som att AI-bildigenkänning luras, kommer detta experiment faktiskt att användas för att ta bort inkonsekvenser i systemet. De som arbetar inom detta område måste nu anpassa sig till bullriga data som kan inkluderas i ämnesbilderna. Detta resultat kan ge maskininlärningsdrivna system en chans att förbättra sig mot liknande bedrägerier i framtiden.

Gadgetshowto

Gadgetshowto